Как создать искусственный интеллект, полезный для людей (Fei Fei Li, Google AI Chief Scientist)

Для области, которая еще десять лет назад была малоизвестна за пределами научных кругов, искусственный интеллект развивается головокружительно быстро. Технологические компании от Кремниевой долины до Пекина ставят на него все, венчурные капиталисты вливают миллиарды в исследования и разработки, а стартапы создаются, кажется, ежедневно. Если наша эпоха - это следующая промышленная революция, как утверждают многие, то AI, несомненно, является одной из ее движущих сил.

Это особенно захватывающее время для таких исследователей, как я. Когда я учился в аспирантуре по информатике в начале 2000-х годов, компьютеры были едва способны обнаружить резкие края на фотографиях, не говоря уже о том, чтобы распознать что-то столь нечетко определенное, как человеческое лицо. Но благодаря росту объема больших данных, развитию алгоритмов, таких как нейронные сети, и обилию мощного компьютерного оборудования произошло нечто судьбоносное: AI превратился из академической ниши в ведущий дифференцирующий фактор в широком спектре отраслей, включая производство, здравоохранение, транспорт и розничную торговлю.

Однако меня беспокоит, что энтузиазм по поводу AI мешает нам задуматься о его грядущих последствиях для общества. Несмотря на свое название, в этой технологии нет ничего “искусственного” - она создана людьми, предназначена для того, чтобы вести себя как люди, и влияет на людей. Поэтому, если мы хотим, чтобы она играла положительную роль в завтрашнем мире, она должна руководствоваться человеческими интересами.

Я называю этот подход “человеко-ориентированным AI”. Он состоит из трех целей, которые могут помочь ответственно подходить к разработке интеллектуальных машин.

Во-первых, AI должен в большей степени отражать глубину, которая характеризует наш собственный интеллект. Рассмотрим богатство человеческого визуального восприятия. Оно сложное и глубоко контекстуальное, и естественным образом уравновешивает наше понимание очевидного с чувствительностью к нюансам. Для сравнения, машинное восприятие остается поразительно узким.

Иногда эта разница тривиальна. Например, в моей лаборатории алгоритм создания подписи к изображению однажды честно охарактеризовал фотографию как “человек верхом на лошади”, но не заметил того факта, что оба изображения были бронзовыми скульптурами. В других случаях разница более глубока, как, например, когда тот же алгоритм описал изображение зебры, пасущейся в саванне под радугой. Хотя резюме было технически правильным, оно было полностью лишено эстетического восприятия, не обнаружив ни вибрации, ни глубины, которые человек мог бы оценить естественным образом.

Это может показаться субъективной или несущественной критикой, но она указывает на важный аспект человеческого восприятия, недоступный нашим алгоритмам. Как мы можем ожидать, что машины смогут предугадывать наши потребности и тем более способствовать нашему благополучию, не имея представления об этих “нечетких” аспектах нашего опыта?

Сделать AI более чувствительным к полному объему человеческого мышления - задача не из простых. Для ее решения, скорее всего, потребуются знания из областей, выходящих за пределы компьютерной науки, а это значит, что программистам придется научиться чаще сотрудничать с экспертами из других областей.

Такое сотрудничество будет представлять собой возвращение к истокам нашей области, а не отход от них. Молодые энтузиасты ИИ могут быть удивлены, узнав, что принципы современных алгоритмов глубокого обучения были заложены более 60 лет назад нейробиологами Дэвидом Хьюбелом и Торстеном Визелем, которые обнаружили, как иерархия нейронов в зрительной коре кошки реагирует на стимулы.

Аналогичным образом, ImageNet, набор данных из миллионов учебных фотографий, который помог развитию компьютерного зрения, основан на проекте под названием WordNet, созданном в 1995 году когнитивным ученым и лингвистом Джорджем Миллером. WordNet был предназначен для организации семантических понятий английского языка.

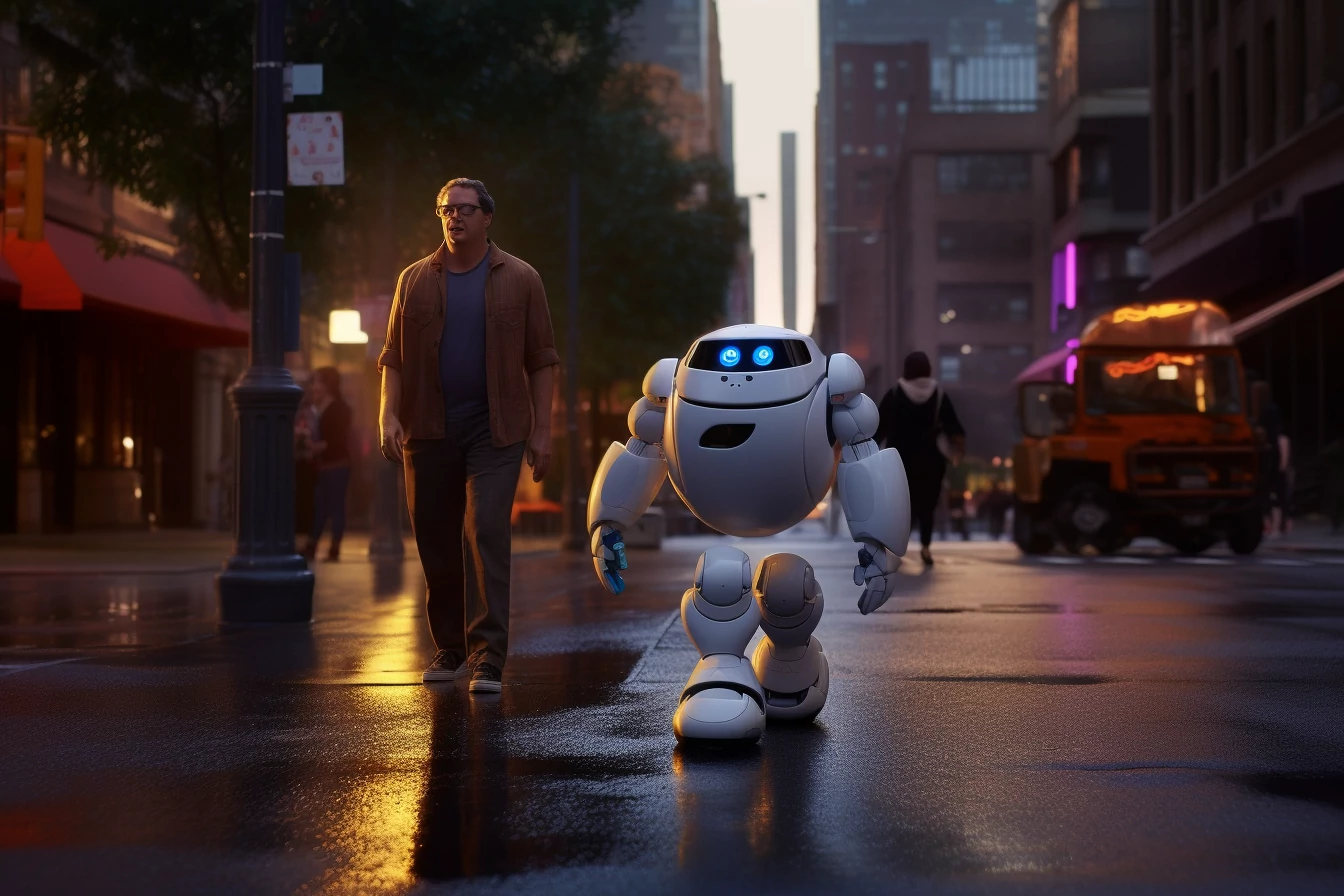

Воссоединение ИИ с такими областями, как когнитивная наука, психология и даже социология, даст нам гораздо более богатую основу для развития машинного интеллекта. И мы можем ожидать, что созданные в результате технологии будут сотрудничать и общаться более естественно, что поможет нам приблизиться ко второй цели человеко-ориентированного ИИ: улучшать нас, а не заменять.

Представьте себе роль, которую ИИ может сыграть во время операции. Цель не обязательно должна заключаться в полной автоматизации процесса. Вместо этого комбинация интеллектуального программного обеспечения и специализированного оборудования может помочь хирургам сосредоточиться на своих сильных сторонах - таких качествах, как ловкость и адаптивность, - одновременно следя за выполнением более рутинных задач и защищая от человеческих ошибок, усталости и отвлечения.

Или рассмотрим уход за пожилыми людьми. Роботы, возможно, никогда не станут идеальными хранителями престарелых, но интеллектуальные датчики уже демонстрируют перспективу помочь людям, ухаживающим за пожилыми людьми, больше сосредоточиться на отношениях с теми, за кем они ухаживают, автоматически контролируя дозировку лекарств и выполняя контрольные списки по технике безопасности.

Это примеры тенденции к автоматизации тех элементов работы, которые являются повторяющимися, подверженными ошибкам и даже опасными. Остаются только творческие, интеллектуальные и эмоциональные роли, для которых люди по-прежнему подходят лучше всего.

Однако никакая изобретательность не сможет полностью устранить угрозу вытеснения рабочих мест. Решение этой проблемы является третьей целью ИИ, ориентированного на человека: обеспечить, чтобы разработка этой технологии на каждом этапе велась с учетом ее влияния на человека.

Сегодняшние опасения по поводу труда - это только начало. Другие подводные камни включают предвзятое отношение к недопредставленным сообществам в машинном обучении, противоречие между аппетитом ИИ к данным и правами на частную жизнь отдельных людей, а также геополитические последствия глобальной гонки интеллектов.

Сегодняшнее беспокойство по поводу труда - это только начало. Другие подводные камни включают предвзятое отношение к недопредставленным сообществам в машинном обучении, противоречия между аппетитом ИИ к данным и правами частных лиц на конфиденциальность, а также геополитические последствия глобальной гонки интеллектов.

Адекватное решение этих проблем потребует обязательств со стороны многих из наших крупнейших институтов. Университеты имеют уникальные возможности для развития связей между информатикой и традиционно несвязанными факультетами, такими как социальные и даже гуманитарные науки, посредством междисциплинарных проектов, курсов и семинаров. Правительства могут приложить больше усилий для поощрения образования в области компьютерных наук, особенно среди девушек, расовых меньшинств и других групп, чьи взгляды были недопредставлены в области ИИ. А корпорации должны сочетать свои агрессивные инвестиции в интеллектуальные алгоритмы с этической политикой в области ИИ, которая сдерживает амбиции и ответственность.

Ни одна технология так не отражает своих создателей, как ИИ. Говорят, что “машинных” ценностей вообще не существует, на самом деле машинные ценности - это человеческие ценности. Ориентированный на человека подход к ИИ означает, что эти машины должны быть не нашими конкурентами, а партнерами в обеспечении нашего благополучия. Какой бы автономной ни стала наша технология, за ее влияние на мир - к лучшему или худшему - всегда будем отвечать мы.